Przewodnik TDWI*: Trendy w analityce danych

*Opracowano na podstawie: Halper, F., Stodder, D. (2014). TDWI Analytics Maturity Model Guide. Interpreting Your Assessment Score. TDWI Research. The Data Warehousing Institute. 1105 Media, Inc.

Analityka wymaga umiejętności gromadzenia, przetwarzania i analizowania stale rosnącej ilości różnych danych. Przyniesie to jednak efekty, gdy wyniki analiz zostaną wykorzystane w procesie decyzyjnym, z odpowiednią szybkością i we właściwym czasie.

Analizy danych kojarzone są przeważnie z arkuszami kalkulacyjnymi, bazami danych, pulpitami nawigacyjnymi (menedżerskimi), zarządzaniem wydajnością i bardziej zaawansowanymi technikami, takimi jak wizualizacja i modelowanie predykcyjne. Tymczasem analityka obejmuje także infrastrukturę i odpowiednie zarządzanie procesami pozyskiwania i przetwarzania danych. Ponadto na analitykę składają się procesy kulturowe i organizacyjne, które umożliwiają firmom pozyskiwanie danych oraz ich analizę. Od pracowników wymaga to odpowiednich umiejętności oraz zdolności do analizy danych i poprawnego wnioskowania. Wszakże analitykę danych tworzą ludzie.

TDWI Analytics Maturity Model

Model dojrzałości analitycznej TDWI (Transforming Data With Intelligence) dostarcza metodologii pomiaru i monitorowania stanu wdrożenia analityki w organizacji. Wskazuje działania jakie powinny zostać podjęte, aby rozwijać kulturę analityczną organizacji. W model TDWI ocena dojrzałości analitycznej organizacji przeprowadzana jest w oparciu o 35 pytań zadawanych w pięciu obszarach dojrzałości analitycznej: organizacyjnym, infrastrukturalnym, zarządzania danymi oraz analizy i zarządzania. W obszarze organizacyjnym pytania koncentrują się na m.in. stopniu, w jakim strategia organizacyjna, kultura, przywództwo, umiejętności i finansowanie wspierają program analityczny. W obszarze infrastrukturalnym pytania koncentrują się na kwestiach związanych z zaawansowaniem i dostępnością infrastruktury dla zastosowań analitycznych. W obszarze zarządzania danymi pytania dotyczą jakości, dostępności i przetwarzania danych, a także sposobu w jaki firma zarządza danymi. Z kolei w obszarze analityki pytania skoncentrowane są na ocenie kultury analitycznej oraz zakresu, w jakim wykorzystywane są narzędzia analityczne (w jaki sposób analityka przyczynia się do podejmowania decyzji w firmie?).

Trendy w analityce danych

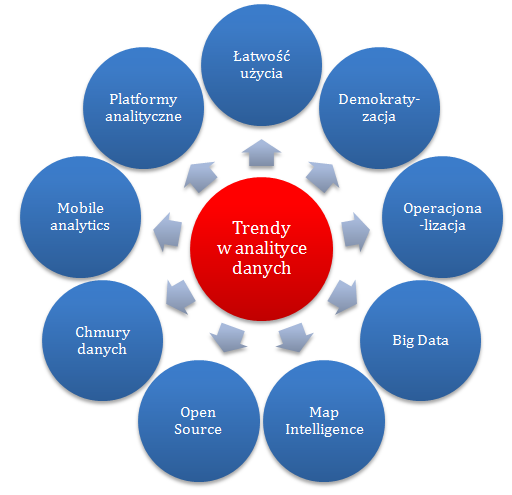

W analityce danych wyróżnić można szereg trendów (ryc. 1). Są one szczególnie istotne dla podmiotów, które chcą stać się bardziej dojrzałe w swoich działaniach analitycznych:

Rycina 1. Trendy w analityce danych. Źródło: opracowanie własne.

Rycina 1. Trendy w analityce danych. Źródło: opracowanie własne.

Łatwość użycia

W przeszłości zaawansowane działania analityczne wykonywane były przeważnie przy pomocy kodu wpisywanego w wierszu poleceń. Wymagało to znajomości szeregu komend. Obecnie zaawansowane analizy danych wykonywane są przy pomocy (graficznych) interfejsów użytkownika, metodą „przeciągnij i upuść” (drag-and-drop). Uprościło to sposób przetwarzania i wizualizacji danych, a także umożliwiło automatyzację wielu procesów. Łatwość użycia ma znaczenie, ponieważ pozwala sprawniej uzyskać wymierne efekty analiz, a następnie wykorzystać je w procesie decyzyjnym (data driven decision making).

Demokratyzacja i konsumeryzacja analityki

Analityka wymaga eksploracji danych, zastosowania różnych wizualizacji (visual data discovery) i technik analitycznych, co prowadzi do konkretnych wniosków. Dostępność danych i oprogramowania oraz łatwość obsługi sprawiają, że analityka jest dostępna dla większej liczby osób w organizacji. Począwszy od szczebla kierowniczego po personel pierwszej linii (frontline personnel), użytkownicy w coraz większym stopniu polegają na danych podczas podejmowania różnych decyzji. Wiele organizacji ma w planach „zdemokratyzować” analitykę, tzn. umożliwić użytkownikom spoza IT samodzielną analizę danych. Samoobsługowe technologie i wizualizacje danych umożliwiają użytkownikom samodzielne tworzenie coraz bardziej zaawansowanych analiz, podczas gdy dział IT oraz personel kierowniczy pozostaje „w tle”. Częścią tego trendu jest również to, że wyniki analiz stają się bardziej dostępne i przydatne dla różnych podmiotów w organizacji (making analytics more consumable).

Demokratyzacja analityki związana jest ze zwiększeniem dostępności pracowników do kokpitów menedżerskich, raportowania, analizy danych i wizualizacji, jedynie przy „cichym” wsparciu IT.

Nowe rodzaje analiz

Oprócz modeli prognostycznych pojawiają się nowe rodzaje analiz. Obejmują one np. analizę tekstu, w tym mediów społecznościowych, analizę geoprzestrzenną i analitykę internetową. Analizy tekstu polegają na wydobywaniu danych z treści i porządkowaniu ich, tak aby można było wyciągać wnioski. Audyt treści może mieć charakter ilościowy lub jakościowy i obejmować np. ocenę przystępności percepcyjnej, analizę semantyczną tekstu lub sentymentu wypowiedzi. Analizy geoprzestrzenne obejmują m.in. dane geokodowane i teledetekcyjne. Z kolei analiza strumieni kliknięć (clickstream analysis, analityka internetowa) pomaga organizacjom zrozumieć zachowanie użytkowników/klientów na stronach internetowych. Organizacje dojrzałe analitycznie dywersyfikują portfel przeprowadzanych analiz.

Big Data

Big data napędza korzystanie z nowej infrastruktury, takiej jak Hadoop i wieloplatformowe środowiska hurtowni danych (multi-platform data warehouse). Przetwarzają one i analizują nowe formy big data, danych niestrukturalnych i danych pozyskiwanych w czasie rzeczywistym (real-time data). Wykorzystanie narzędzi do przetwarzania dużych ilości danych umożliwia analitykom pracę na większych zbiorach danych, zapewniając bardziej niezawodne modele i trafniejsze raporty. Ponadto zmniejsza prawdopodobieństwo wystąpienia błędów próbkowania, które mogą pojawić się w przypadku mniejszych zbiorów danych.

Analityka 3.0 – agile is too slow…

Open source

Otwarte oprogramowanie znalazło zastosowanie także w analityce. Przykładem tego może być platforma Apache Hadoop. Ten ekosystem narzędzi i technik powstał, aby system plików Hadoop Distributed File System (HDFS) był bardziej przyjazny dla użytkowników. Dowodem rosnącej popularności open source w analityce danych jest także coraz częstsze zastosowanie języka R na froncie analitycznym – wielu dostawców rozwiązań analitycznych już włączyło obsługę R do swoich pakietów. Język programowania Python, o otwartym kodzie źródłowym, jest także coraz częściej stosowany przez analityków. Open source umożliwia użytkownikom wprowadzanie innowacji i to właśnie dzieje się w ekosystemach analitycznych.

Mobilny BI i platformy analityczne

Badania TDWI pokazały, że coraz więcej firm korzysta z platform analitycznych. Pozwalają one zarządzać danymi, przygotowywać dane i je analizować. Rosnące wykorzystanie urządzeń mobilnych sprawiło, że powstały nowe platformy, z których użytkownicy mogą uzyskać dostęp do danych, a także inicjować i wykorzystywać analizy. Menadżerowie pozostający „w ruchu” mogą korzystać z „mobilnych analiz”, aby uzyskać dokładniejszy wgląd w dane o wynikach biznesowych, podczas gdy pracownicy działów sprzedaży i serwisu mogą poprawić zaangażowanie klientów, korzystając z wizualizacji danych. Ponadto, aby rozwiązać problemy związane z bezpieczeństwem, wydajnością i dostępnością, niektóre organizacje wdrażają usługi w chmurze.

The Cloud

Jednym z powodów, dla których organizacje wdrażają rozwiązania w chmurze jest redukcja kosztów, wynikająca m.in. z braku nakładów kapitałowych na infrastrukturę i jej utrzymanie, a nawet personel techniczny, co może uczynić analitykę danych bardziej opłacalną. Coraz częściej firmy przechowują duże ilości danych w chmurze, a następnie tam z nimi eksperymentują.

Pingback: Analityka 3.0: develop products, not PowerPoints or reports! – Karol Król